Dans le monde de l’informatique, le stockage des données est un élément crucial pour assurer le bon fonctionnement de vos équipements et pour sauvegarder vos données. Vous êtes probablement déjà familiarisés avec les termes « SSD » et « HDD ». Mais quelles sont toutes les différence entre ces deux types de stockage ? Lequel est le mieux adapté à vos besoins ? Dans cet article, nous vous présentons les caractéristiques et les avantages de ces deux technologies, afin de vous aider à choisir le meilleur disque pour votre ordinateur que ce soit pour un ordinateur portable, fixe ou pour un disque dur externe.

Si vous êtes pressés :

Les avantages des HDD

Les avantages des SSD

Les disques SSD : rapidité et performances au rendez-vous

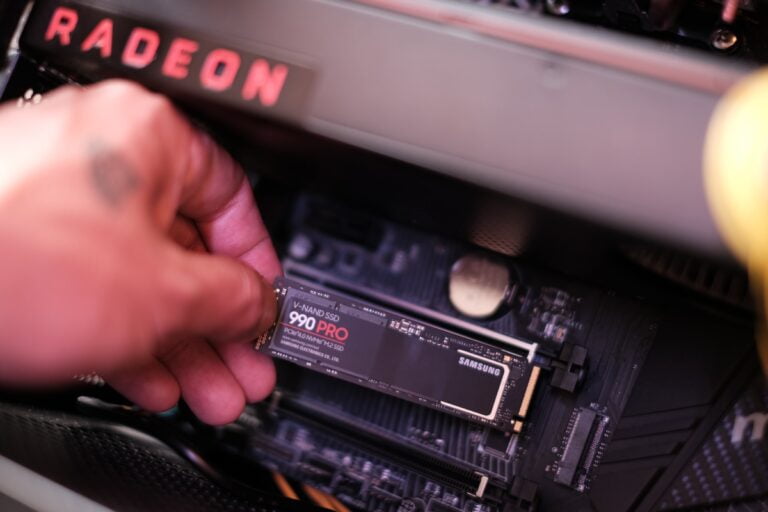

Les disques SSD, ou Solid State Drives représentent une innovation en matière de stockage de données. Contrairement aux disques durs traditionnels (HDD), les SSD n’utilisent pas de plateaux magnétiques en rotation pour stocker vos fichiers. Au lieu de cela, ils utilisent de la mémoire flash NAND, similaire à celle que l’on trouve dans les clés USB et les cartes mémoire.

Rapidité et vitesse de lecture

L’un des principaux avantages des disques SSD est leur vitesse de lecture et d’écriture. Grâce à l’absence de pièces mécaniques mobiles, les SSD sont capables de lire et d’écrire des données beaucoup plus rapidement que les HDD. De plus, la mémoire flash NAND utilisée dans les SSD permet un accès quasi instantané aux données, réduisant considérablement les temps de chargement et d’installation de vos applications et systèmes d’exploitation.

Performances générales améliorées

Un autre avantage des SSD est l’amélioration des performances générales de votre ordinateur. En effet, un disque SSD permet à votre machine de démarrer plus rapidement, de charger les programmes en un clin d’œil et de réduire les temps d’attente lors des transferts de fichiers. Cela se traduit par une expérience utilisateur beaucoup plus fluide et agréable, que vous soyez sur Windows ou sur Mac.

Les vitesses de lecture séquentielle des SSD SATA varient généralement entre 450 Mo/s et 550 Mo/s. Les modèles haut de gamme peuvent atteindre des vitesses de lecture proches de la limite théorique de 550 Mo/s. Pour les vitesses d’écriture séquentielle, ils se situent généralement entre 400 Mo/s et 520 Mo/s. Comme pour les vitesses de lecture, les modèles haut de gamme peuvent atteindre des vitesses d’écriture proches de la limite théorique.

Durabilité et consommation d’énergie

Les disques SSD sont également plus durables et consomment moins d’énergie que les disques durs traditionnels. Comme ils ne contiennent pas de pièces mécaniques mobiles, les SSD sont moins susceptibles de subir des dommages dus aux chocs, aux vibrations ou à l’usure mécanique. De plus, leur faible consommation d’énergie permet de prolonger la durée de vie de la batterie de votre ordinateur portable.

Les disques HDD : capacité de stockage et prix attractifs

Les disques durs (HDD), ou Hard Disk Drives, sont la technologie de stockage de données la plus ancienne et la plus répandue. Ils fonctionnent grâce à des plateaux magnétiques en rotation, sur lesquels sont enregistrées vos données.

Capacité de stockage importante

L’un des principaux avantages des disques HDD est leur grande capacité de stockage. En effet, les disques durs sont disponibles dans des tailles allant jusqu’à plusieurs téraoctets (To), ce qui vous permet de stocker une quantité impressionnante de données, de fichiers et de programmes. Si vous avez besoin d’une grande capacité de stockage pour des projets vidéo, de la musique ou des jeux, un disque dur peut être un choix judicieux.

Prix plus abordable

Un autre avantage des disques HDD est leur prix généralement plus abordable que celui des SSD. Les disques durs offrent un meilleur rapport capacité/prix, ce qui les rend plus accessibles pour les personnes ayant un budget limité. Si vous recherchez une solution de stockage économique pour votre ordinateur, les disques durs peuvent être une option intéressante.

Compatibilité et évolutivité

Enfin, les disques HDD sont compatibles avec la plupart des systèmes et des configurations, ce qui facilite leur intégration dans votre ordinateur. De plus, leur évolutivité vous permet d’ajouter facilement de l’espace de stockage supplémentaire en installant un nouveau disque dur ou en remplaçant l’ancien.

Choisir entre un SSD et un HDD : des critères à prendre en compte

Pour déterminer quel type de disque de stockage est le mieux adapté à vos besoins, plusieurs critères sont à prendre en compte. Voici quelques éléments à considérer lors de votre choix.

Vos besoins en matière de performances

Si vous recherchez les meilleures performances possibles pour votre ordinateur, les disques SSD sont sans aucun doute la meilleure option. Leur rapidité et leur réactivité vous offriront une expérience utilisateur optimale, que vous utilisiez votre machine pour jouer, travailler ou simplement naviguer sur Internet.

Votre budget

Comme mentionné précédemment, les disques HDD sont généralement moins chers que les SSD. Si votre budget est limité, opter pour un disque dur peut être une solution économique pour augmenter la capacité de stockage de votre ordinateur sans sacrifier trop de performances. En 2023, un disque dur classique de 1 to vaut approximativement une quarantaine d’euros, alors qu’un SSD de la même taille vaut environ 60 euros.

La capacité de stockage dont vous avez besoin

Si vous avez besoin d’une grande capacité de stockage pour conserver une large quantité de données, un disque dur peut être un choix judicieux. Les disques durs offrent en effet de grandes capacités de stockage à un prix abordable, alors que les SSD de grande taille peuvent être nettement plus coûteux.

La durabilité et la consommation d’énergie

Si vous souhaitez un disque de stockage durable et économe en énergie, les disques SSD sont un choix approprié. Leur absence de pièces mécaniques mobiles et leur faible consommation d’énergie les rendent moins sensibles aux dommages et prolongent la durée de vie de la batterie de votre ordinateur portable.

Les disques hybrides : une solution intermédiaire

Si vous êtes toujours indécis entre un disque SSD et un disque HDD, une autre option s’offre à vous : les disques hybrides, également appelés SSHD (Solid State Hybrid Drives). Ces disques combinent les avantages des deux technologies en intégrant à la fois de la mémoire flash NAND (comme les SSD) et des plateaux magnétiques (comme les HDD).

Les avantages des disques hybrides

Les disques hybrides offrent un compromis intéressant entre vitesse et capacité de stockage. Ils utilisent la mémoire flash pour stocker les données les plus fréquemment utilisées, ce qui permet d’accélérer les temps de démarrage, de chargement des programmes et d’accès aux fichiers. Le reste des données est stocké sur les plateaux magnétiques, qui offrent une capacité de stockage plus importante et un prix plus abordable que les SSD.

Quand choisir un disque hybride ?

Les disques hybrides peuvent être une solution intéressante si vous recherchez un équilibre entre la rapidité des SSD et la capacité de stockage des HDD. Ils constituent également une option économique pour ceux qui souhaitent améliorer les performances de leur ordinateur sans investir dans un disque SSD de grande capacité.

En somme, le choix entre un disque SSD et un disque HDD dépendra de vos besoins en matière de performances, de capacité de stockage, de durabilité et de budget. Les SSD sont la meilleure option pour ceux qui recherchent vitesse et réactivité, tandis que les HDD sont plus adaptés aux personnes ayant besoin d’une grande capacité de stockage à un prix abordable. Les disques hybrides offrent quant à eux un compromis intéressant entre ces deux technologies.

Récupération des données : une différence importante entre SSD et HDD

Un autre aspect à prendre en compte lors du choix entre un disque SSD et un disque HDD concerne la récupération des données en cas de panne ou de dommage.

Récupération des données sur un disque SSD

Les disques SSD étant basés sur de la mémoire flash NAND, la récupération des données peut s’avérer plus complexe et coûteuse en cas de défaillance. En effet, les données stockées sur un disque SSD peuvent être réparties de manière non continue, ce qui complique la tâche pour les logiciels et services de récupération de données.

Récupération des données sur un disque HDD

Les disques HDD stockent les données de manière séquentielle sur des plateaux magnétiques, ce qui facilite la récupération des données en cas de panne ou de dommage. De plus, les techniques et outils de récupération de données sur un disque HDD sont généralement plus accessibles et moins coûteux que pour les disques SSD.

Conclusion : choisir le stockage de données adapté à vos besoins

Le choix entre un disque SSD et un disque HDD dépendra principalement de vos besoins en matière de performances, de capacité de stockage, de durabilité et de budget. Les disques SSD sont la meilleure option pour ceux qui recherchent vitesse et réactivité, tandis que les disques HDD sont plus adaptés aux personnes ayant besoin d’une grande capacité de stockage à un prix abordable. Les disques hybrides offrent quant à eux un compromis intéressant entre ces deux technologies.