Les mystères du monitoring de site web efficace vous sont enfin dévoilés ! Pour réussir dans la quête de la haute disponibilité, il est essentiel de surveiller et d’optimiser les performances de son site. Comment y parvenir ? En utilisant des outils de surveillance et en suivant les meilleures pratiques pour garantir la disponibilité et les performances de vos précieux sites web. Poursuivez l’aventure pour découvrir les ingrédients qui rendront votre monitoring infaillible.

Plongez avec enthousiasme dans l’univers du monitoring, où chaque outil devient votre allié pour déceler les problèmes et améliorer les performances. Surveillez sans relâche serveurs, pages et applications grâce à des fonctionnalités innovantes offertes par des logiciels dédiés. Les données recueillies vous guideront vers la version ultime de votre site web, assurant un temps de disponibilité remarquable et une expérience utilisateur exmplaire.

La surveillance des sites web, une nécessité absolue

La surveillance des sites permet de détecter rapidement les problèmes et d’assurer une disponibilité optimale pour vos utilisateurs. Garder un œil attentif sur les performances est un véritable gage de qualité pour votre site, car des pages lentes ou inaccessibles peuvent rebuter même les plus fervents explorateurs du web. Les outils de monitoring sont ainsi vos meilleures armes pour repérer tout incident sur votre serveur ou votre page web. Une fois que votre site Internet est en ligne et au coeur de votre business, sa disponibilité doit faire partie de votre préoccupation principale.

Entre les temps de chargement prolongés, les erreurs liées à l’hébergement web, chaque obstacle peut à la fois éloigner vos visiteurs mais également les moteurs de recherche. Assurer une disponibilité proche de 100% et des temps de chargement réduit augmentera vos chance de transformation de vos visiteurs en clients.

Dans un monde où la concurrence est féroce, chaque seconde compte pour satisfaire les internautes et avoir un site performant.

Les meilleurs outils pour le monitoring de sites web

Au royaume des outils de monitoring, certains se démarquent par leur efficacité et leurs fonctionnalités innovantes. Ces outils magiques vous permettront d’assurer la performance et la disponibilité de vos sites en temps réel.

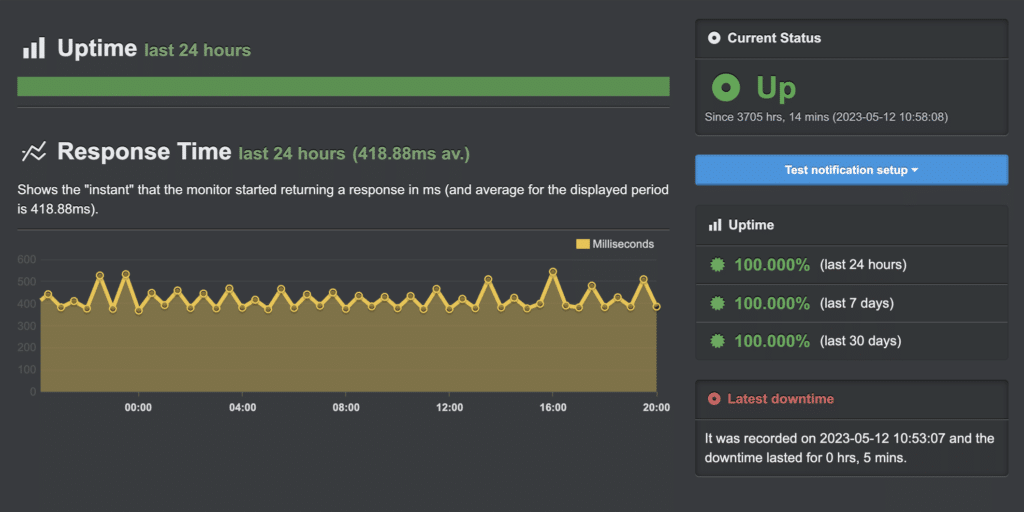

Uptime robot

Uptime Robot est un service de surveillance de disponibilité en ligne de premier plan, conçu pour aider les entreprises et les particuliers à garder un œil sur leurs sites Web, serveurs et autres ressources en ligne.

Avec une interface utilisateur simple et intuitive, le service offre une surveillance en temps réel avec des intervalles de vérification aussi courts que 30 secondes. Actuellement, Uptime Robot surveille plus de 7,5 millions de moniteurs pour plus de 2,1 millions d’utilisateurs et d’entreprises à travers le monde.

Le service propose une gamme de fonctionnalités avancées, y compris des alertes par e-mail, SMS, appels vocaux automatisés, et des intégrations avec des plateformes populaires comme Slack, Telegram, et Microsoft Teams. Il offre également des pages de statut pour informer vos clients de tout incident ou maintenance planifiée, renforçant ainsi la transparence et la confiance.

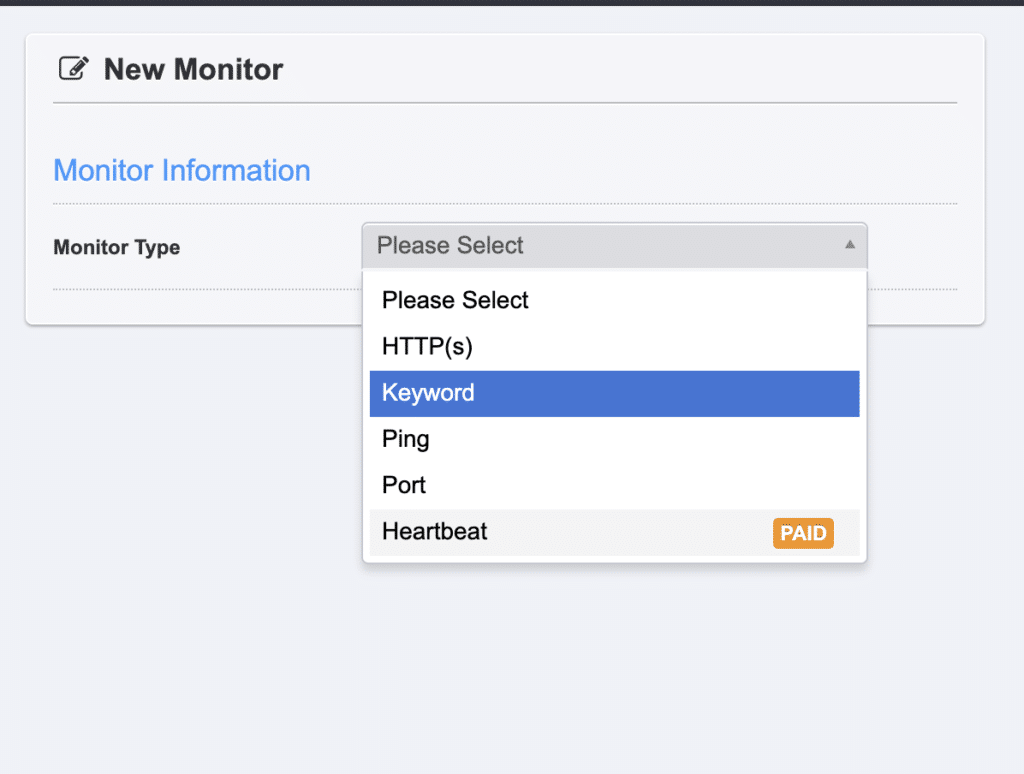

En plus de vérifier la disponibilité de votre site, vous pouvez également rechercher un keyword dans une page pour être sûr que les données de votre sites Internet sont bien affichées.

Points forts

- Surveillance Complète : lffre une gamme de types de surveillance, de sites Web à certificats SSL.

- Alertes Multicanal : diverses méthodes d’alerte, y compris e-mail, SMS et intégrations avec Slack et Telegram.

- Facilité d’Utilisation : mise en route rapide et interface utilisateur intuitive.

Points faibles

- Limitations de la Version Gratuite : plan gratuit limité en termes d’intégrations et de fonctionnalités.

- Coût pour Fonctionnalités Avancées : les plans payants nécessaires pour plus de fonctionnalités peuvent être coûteux.

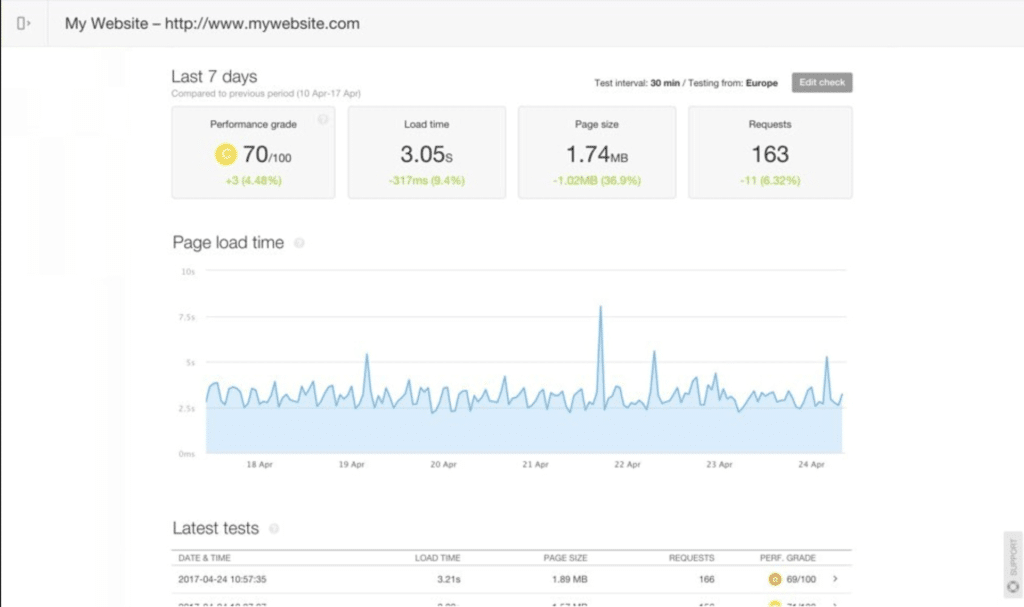

Pingdom

Pingdom est une plateforme de surveillance de l’expérience utilisateur final qui vise à optimiser la performance et la disponibilité des sites web.

Propulsé par SolarWinds, ce service combine à la fois la surveillance synthétique et la surveillance des utilisateurs réels pour fournir une visibilité complète et des informations exploitables en temps réel.

Que vous soyez un développeur web, un fournisseur d’hébergement ou un spécialiste du marketing numérique, Pingdom vous offre les outils nécessaires pour comprendre comment les utilisateurs interagissent avec votre site web, tout en vous alertant immédiatement en cas de problèmes de performance ou de disponibilité.

Points forts

- Surveillance Complète : offre à la fois la surveillance synthétique et des utilisateurs réels pour une visibilité totale.

- Alertes Personnalisables : permet de définir des KPIs et SLAs propres, avec des alertes immédiates en cas d’incident.

- Analyse de Vitesse : fournit des données détaillées sur la vitesse de chargement pour optimiser la performance.

Points faibles

- Complexité : peut être difficile à naviguer pour ceux qui cherchent une solution plus simple.

- Coût : les plans tarifaires peuvent être onéreux pour les petites entreprises.

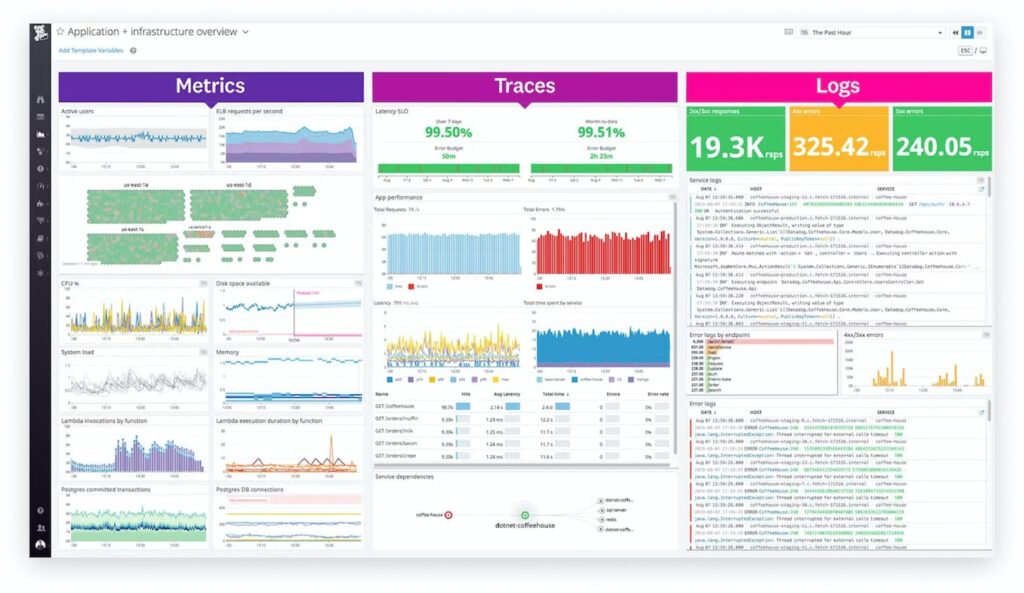

Datadog

Datadog est une plateforme de surveillance et de sécurité moderne conçue pour offrir une visibilité complète sur n’importe quelle pile technologique, application ou environnement, quel que soit son échelle ou son emplacement.

La plateforme propose une gamme étendue de fonctionnalités, allant de la surveillance de l’infrastructure à la gestion des journaux, en passant par la surveillance des performances des applications (APM), la surveillance de la sécurité, la surveillance du réseau et bien plus encore.

Datadog se positionne comme un leader dans le domaine de l’intelligence artificielle pour les opérations informatiques, offrant des solutions qui permettent aux équipes de développement, aux équipes d’exploitation informatique et aux utilisateurs commerciaux de travailler de manière plus efficace dans l’ère du cloud.

Points forts

- Visibilité Complète : vue d’ensemble à des détails profonds sur toute l’infrastructure.

- Polyvalence des Fonctionnalités : solution tout-en-un pour la surveillance et la sécurité.

- Évolutivité : s’adapte facilement à n’importe quelle échelle.

Points faibles

- Complexité : peut être difficile à maîtriser en raison de ses nombreuses fonctionnalités.

- Coût : peut être coûteux pour les petites entreprises ou les budgets limités.

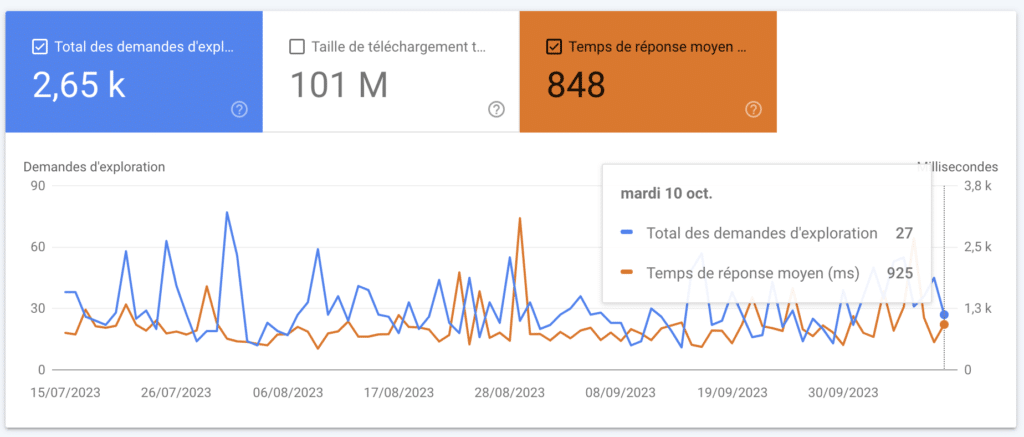

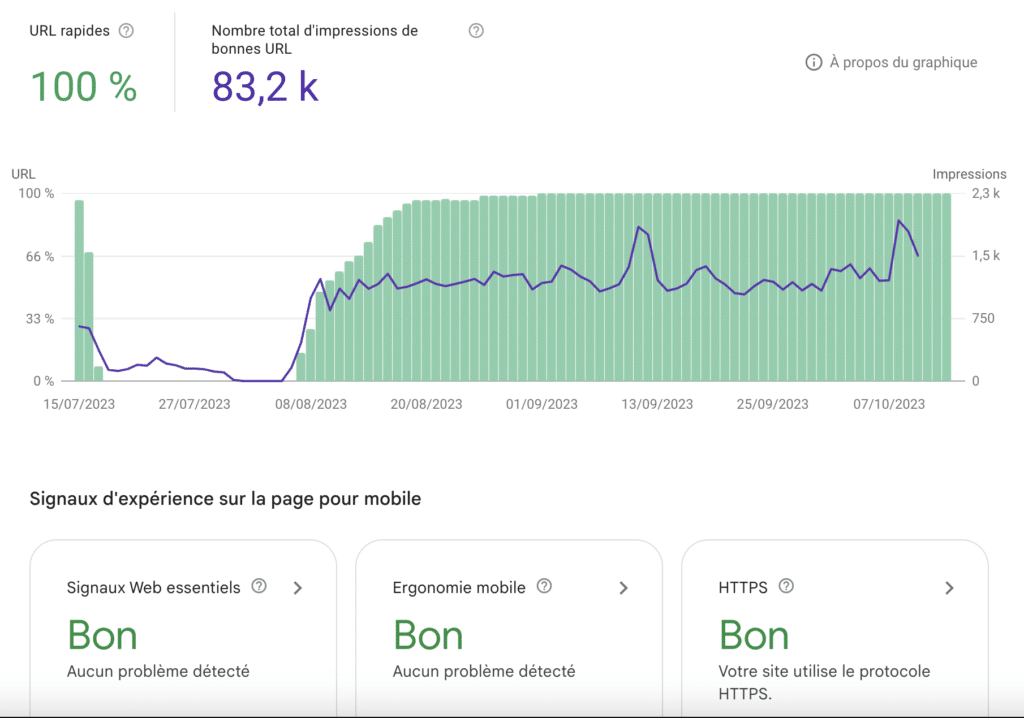

Google Search Console

La Google Search Console est un outil gratuit et indispensable pour toute personne cherchant à monitorer et à optimiser la présence de son site Web dans les résultats de recherche Google.

Elle offre une panoplie de fonctionnalités qui permettent non seulement de suivre les performances de votre site en termes de trafic et de classement, mais aussi d’identifier et de résoudre divers problèmes techniques et de sécurité. Elle alerte les propriétaires de sites Web sur les éventuels problèmes d’indexation ou de compatibilité mobile, permettant ainsi une intervention rapide pour améliorer l’expérience utilisateur. Pour monitorer votre site Web, certaines sections vous indiquent le temps de chargement des pages ou encore leurs temps de réponse.

Ces précieux alliés vous aideront à mieux comprendre les besoins de vos utilisateurs et à résoudre rapidement les problèmes rencontrés. Choisissez-les avec soin, car chaque site web a ses spécificités et mérite une attention toute particulière.

Points forts

- Réactivité aux Problèmes : la Google Search Console vous permet de réagir rapidement aux problèmes d’indexation, de chargement ou de sécurité, ce qui est essentiel pour maintenir une bonne visibilité en ligne.

- Amélioration de l’Expérience Utilisateur : en vous alertant sur les problèmes de compatibilité mobile et autres erreurs techniques, la Google Search Console vous aide à offrir une meilleure expérience à vos visiteurs.

- Erreurs de crawl : vous pouvez détecter toute sorte d’erreur http (404, 410 …), de problème d’url canonique

Points faibles

- Courbe d’Apprentissage : pour les débutants, la Google Search Console peut sembler complexe et intimidante, ce qui peut retarder l’exploitation optimale de ses fonctionnalités.

- Données Limitées dans le Temps : l’outil ne conserve les données que pour une période de 16 mois, ce qui peut être insuffisant pour des analyses à long terme.

- Données accessibles après un certains temps : pas de temps réel sur les données présentées ici.

Les indicateurs clés à suivre pour un monitoring réussi

Une multitude d’indicateurs peuvent être suivis, mais il convient de se concentrer sur ceux qui ont un réel impact sur l’expérience des utilisateurs et la stabilité du site. Parmi ceux-ci, on peut citer le temps de disponibilité, le temps de chargement des pages ou encore les erreurs http.

En veillant sur ces indicateurs clés, vous serez en mesure d’identifier rapidement les problèmes éventuels et d’agir en conséquence. Par exemple, vous pouvez mettre en place des alertes pour être informé en temps réel lorsque votre site web rencontre des difficultés. Ainsi, vous pourrez réagir promptement pour résoudre la situation et éviter les conséquences négatives sur l’expérience de vos visiteurs.

La surveillance en temps réel

Le monitoring en temps réel permet d’assurer une surveillance constante de votre site web et d’identifier les problèmes dès leur apparition. En étant proactif, vous pouvez garantir aux utilisateurs une expérience fluide et agréable.

L’analyse des données

La collecte et l’analyse des données issues du monitoring de votre site sont indispensables pour identifier les tendances et anticiper les éventuelles problématiques. Cela vous offre la possibilité d’améliorer continuellement la performance de votre site web.

La gestion des alertes

Les alertes sont un moyen efficace de rester informé sur l’état de votre site web. En configurant correctement les notifications, vous pouvez agir rapidement en cas de problème et limiter l’impact sur vos visiteurs. Vous pouvez recevoir des alertes par email lorsque votre site est lent ou lors qu’il ne répond plus.

Finalement, le monitoring de sites web s’impose comme un élément indispensable pour assurer la performance et la disponibilité de votre plateforme en ligne. Les meilleures pratiques et indicateurs clés abordés dans cet article vous permettront d’améliorer significativement l’expérience utilisateur sur votre site. N’oubliez pas que la satisfaction des internautes est au cœur du succès de votre projet web. Alors, êtes-vous prêt à mettre en place une surveillance efficace et à propulser votre site vers de nouveaux sommets ? Le moment est venu de passer à l’action et d’optimiser votre monitoring pour obtenir des résultats remarquables.